Par Cécile Petitgand (Ph.D. U. Paris-Dauphine et Sao Paulo), chercheuse au regroupement JusticIA de l’Université de Montréal et à l’Observatoire international sur les impacts sociétaux de l’IA et du numérique (OBVIA) et Conseillère sénior – Volet Innovation & Intelligence artificielle (IA) au Centre hospitalier de l’Université de Montréal (CHUM).

Photo by engin akyurt on Unsplash

Depuis quelques mois, nous assistons à une multiplication des solutions technologiques visant à mieux gérer et combattre la COVID-19 grâce aux avancées de l’intelligence artificielle (IA). Les algorithmes intelligents, intégrés aux dispositifs médicaux et aux technologies de communication, permettraient ainsi de détecter plus efficacement les signes de la maladie et de mieux soigner les patients, sans qu’il soit nécessaire de multiplier avec eux les contacts physiques.

Ces avancées technologiques remarquables sont toutefois contrebalancées par un fait majeur : il n’existe aujourd’hui au pays aucun processus réglementaire entièrement balisé qui permette de garantir non seulement l’efficacité des dispositifs d’IA mais aussi et surtout leur fiabilité en milieu de soins. Comme nous allons le voir dans ce billet, si des technologies de diagnostic reposant sur l’IA sont aujourd’hui en cours d’homologation auprès de Santé Canada, peu d’entre elles ont encore fait leurs preuves diagnostiques et thérapeutiques. Comment pourrait-on finalement accélérer la réalisation des promesses de l’IA dans nos organisations de santé?

L’IA au service de la lutte contre la COVID-19

Les premières technologies d’IA pour le dépistage de la COVID-19 ont fait leur apparition en Chine, au commencement de la pandémie. Des chercheurs ont constitué des bases de données de radiographies pulmonaires de patients infectés en vue d’entraîner des algorithmes capables de dépister la présence de la maladie sur de nouveaux patients en seulement quelques minutes. Suite à ces percées technologiques, plusieurs fois reproduites sur le continent nord-américain, des entreprises du domaine de l’IA ont adapté leurs produits et services afin de commercialiser de telles solutions de diagnostic. C’est ainsi que des algorithmes de dépistage de la tuberculose tels CAD4TB et XrAI ont été entraînés avec des données COVID pour trouver une nouvelle utilité en pleine pandémie. Au pays, la solution XrAI a d’ailleurs été homologuée par Santé Canada suite à un processus d’approbation accéléré. Aucune donnée, toutefois, n’a été fournie au public concernant la conduite d’un tel processus. On sait seulement que des évaluations cliniques auraient permis de garantir l’efficacité et la sécurité de ce dispositif. Mais a-t-on utilisé des données canadiennes, provenant de nos patients infectés par la COVID-19, pour évaluer la performance de la technologie XrAI?

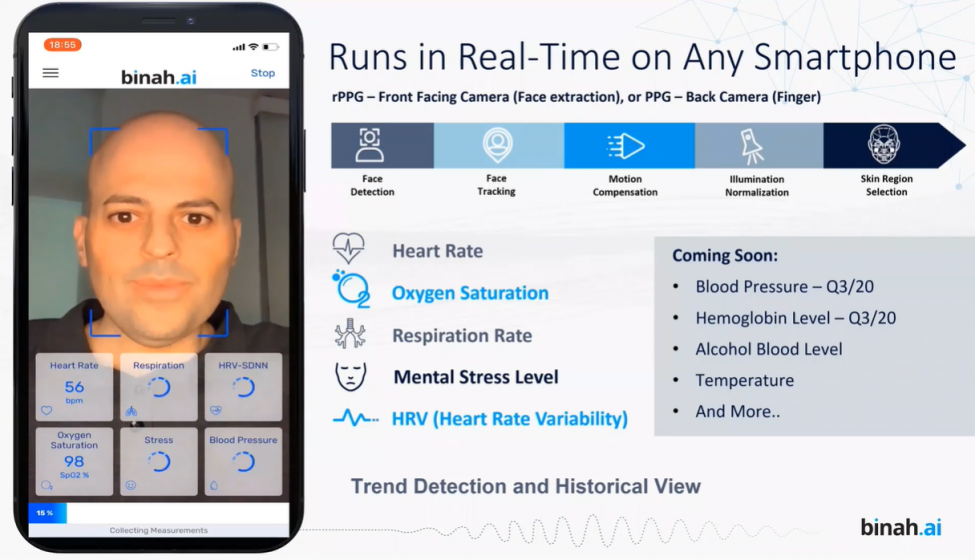

Le Québec est un acteur majeur de l’avancée de l’IA dans le domaine des soins et services de santé. Comme on le sait, MILA – Institut québécois d’intelligence artificielle est très engagé dans le développement de solutions visant à combattre la COVID-19 (voir par exemple le parcours de l’application de notification de contacts COVI). Dans le domaine du dépistage, toutefois, ce sont des solutions provenant d’autres provinces et de l’étranger qui ont été testées dans nos centres hospitaliers. Ainsi, l’application de l’entreprise israélienne Binah, qui vise à analyser les signes vitaux d’un patient à l’aide d’une application intelligente, est actuellement en évaluation clinique à l’Hôpital Juif de Montréal. La solution développée par la compagnie semble révolutionnaire ; elle serait capable de mesurer votre fréquence cardiaque, taux d’oxygène sanguin, niveau de stress et variabilité de la fréquence cardiaque en quelques minutes grâce à la seule caméra d’un cellulaire.

La solution de Binah est actuellement en cours d’homologation aux États-Unis, en Europe, au Japon et au Canada. Mais avant même d’être certifiée, elle a déjà été testée en Inde et maintenant au Québec. Est-ce acceptable, pourrait-on se demander, de voir entrer dans nos organisations de santé des applications d’IA non encore homologuées par des organismes publics? Un tel questionnement est certes légitime, mais il doit être confronté à une autre réalité. Les développeurs de technologies d’IA se doivent d’avoir accès à des milieux de soins complexes afin de tester leurs applications avec de « vrais » patients et de « vrais » cliniciens, en vue de corriger le tir et de rendre leurs technologies plus performantes et mieux adaptées aux besoins locaux. Finalement, ce sont les établissements de soins où les solutions d’IA sont testées qui sont en première ligne lorsqu’il s’agit de poser les jalons indispensables à la garantie de la sécurité des patients et des cliniciens qui seront les premiers utilisateurs de ces technologies.

Les organisations de santé investies dans un déploiement responsable de l’IA

Aujourd’hui, de nombreux organismes réglementaires à travers le monde travaillent à l’adaptation de leurs processus d’homologation en vue de répondre aux enjeux spécifiques soulevés par le déploiement de l’IA dans les établissements de soins. Aux dires de ses représentants (car aucun document n’a encore été publié), un nouveau processus de certification serait en cours de développement à Santé Canada pour évaluer le niveau de sécurité et la performance des dispositifs médicaux intégrant de l’IA. Aux États-Unis, la Food & Drug Administration semble plus avancée dans ses travaux réglementaires, comme en témoigne la publication l’an dernier d’un document de discussion dédié à l’encadrement des dispositifs d’apprentissage automatique en santé. Cette publication propose notamment d’exiger des industriels la soumission d’un descriptif des phases d’apprentissage de leurs solutions d’IA avant leur mise sur le marché, de manière à mieux anticiper les risques associés à l’entraînement et l’évolution des algorithmes en milieu réel. De telles évolutions réglementaires sont nécessaires pour accélérer le déploiement responsable des solutions d’IA, tout particulièrement en temps de pandémie, mais elles sont encore insuffisantes pour outiller adéquatement les organisations de santé qui font face à la demande d’industriels soucieux de déployer leur solutions technologies en milieu réel.

Au Centre hospitalier de l’Université de Montréal (CHUM), où je travaille en tant que Conseillère Innovation & IA, un groupe de travail transdisciplinaire et inter-direction a été mis sur pied pour développer un guide de l’innovation numérique et de l’IA responsables. Ce guide vise principalement à traduire les principes de l’IA responsable consignés dans la Déclaration de Montréal en actions et décisions concrètes au sein de l’établissement et de son écosystème. Il énoncera les principaux enjeux associés aux solutions d’IA (transparence et explicabilité, protection de la confidentialité, responsabilité des utilisateurs, etc.) et proposera une marche à suivre pour leur apporter une réponse. Par exemple, les gestionnaires du CHUM pourront utiliser ce guide pour poser les « bonnes questions » aux porteurs de projets d’IA qui souhaitent tester leur innovation auprès des patients et cliniciens. Ces questions s’inspireront des grilles d’analyse actuellement proposées par plusieurs institutions pour évaluer les technologies d’IA déployées en milieu clinique, comme celle de la Haute Autorité de Santé française.

Le guide du CHUM permettra ainsi de soutenir les équipes sur le terrain (gestionnaires, cliniciens, chercheurs, personnels de soutien), les patients et le public en vue d’assurer le suivi en continu des innovations d’IA, de leur design et développement à leur analyse d’impact et adoption. Une telle démarche, en temps de pandémie, est essentielle pour favoriser la mise en œuvre d’un écosystème d’innovation ouverte et inclusive qui permette à diverses populations de devenir des parties prenantes de l’analyse de la pertinence clinique et sociale des applications d’IA. Cette initiative est aussi complémentaire des travaux réglementaires qui sont conduits à plus grande échelle au Canada et au Québec dans le but de mieux anticiper les risques de l’IA en santé et de maximiser ses bénéfices pour les populations.

Ce contenu a été mis à jour le 10 février 2022 à 16 h 07 min.

Commentaires

1 commentaires pour “Dépister la COVID par l’IA, est-ce pour maintenant?”